No dia 20 de março de 2023, ocorreu um bug nos códigos do ChatGPT que resultou no vazamento de dados, como nome, e-mail, endereço, histórico de conversa e dados de cartão de crédito, de 1,2% dos assinantes do ChatGPT Plus.

Além de ter durado nove horas, a vulnerabilidade só foi descoberta quatro dias depois, pela empresa de cibersegurança Greynoise.

Por conta disso, governos de vários países começaram a questionar a segurança e a transparência na coleta dos dados pela OpenAI, empresa criadora do ChatGPT.

E, em 31 de março, a Autoridade de Proteção de Dados da Itália decidiu suspender temporariamente o funcionamento do ChatGPT no país, com multa de 20 milhões de euros caso a OpenAI não cumpra a decisão em até 20 dias.

Os problemas de privacidade

Apesar de mencionar os direitos de usuários do Espaço Comum Europeu, Reino Unido, Suíça e da Califórnia, a política de privacidade do ChatGPT não fornece informações básicas acerca do processamento dos dados pessoais, conforme solicitado pelo Regulamento Geral sobre Proteção de Dados (RGPD) da Europa e pela Lei Geral de Proteção de Dados (LGPD) do Brasil.

Além disso, não fica claro como, a duração ou o porquê do armazenamento das informações pessoais dos usuários. E, ainda que a OpenAI diga que os usuários podem revogar as permissões para o uso de seus dados pessoais, não existe uma instrução de como, realmente, fazer isso.

Por fim, ademais todas as dúvidas envolvendo a segurança dos dados dos usuários, o ChatGPT também apresenta questões quanto aos direitos autorais: a ferramenta funciona usando informações presentes na internet e geradas por terceiros (como artigos, notícias, livros, imagens e outros), mas a OpenAI não paga para usar esse conteúdo.

Especialistas pedem pausa no desenvolvimento de Inteligência Artificial

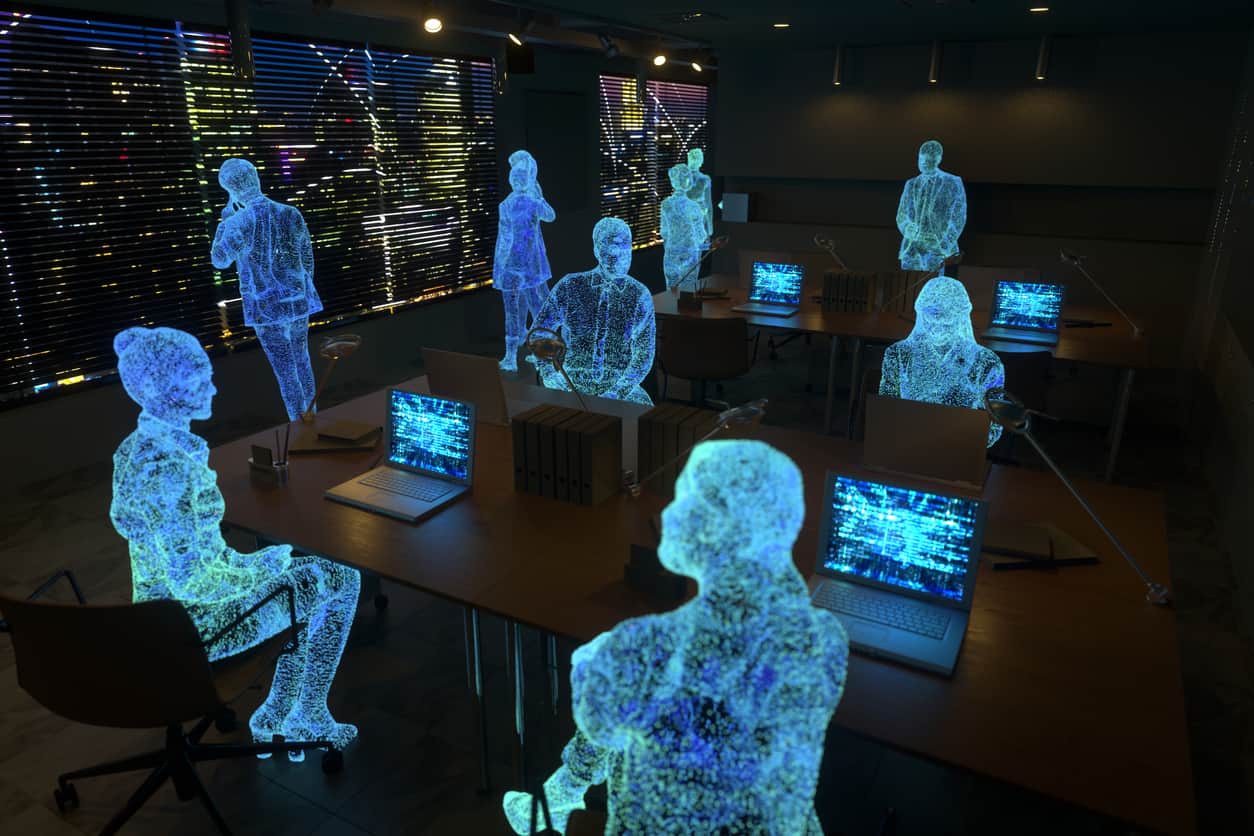

Dias antes da decisão italiana de suspender o ChatGPT, um grupo com dezenas de executivos do setor da tecnologia, incluindo Elon Musk, pediu para que os laboratórios de inteligência artificial (IA) interrompam temporariamente o desenvolvimento de tais ferramentas.

O grupo afirma que a “corrida desenfreada” por desenvolver ferramentas cada vez mais poderosas, que nem mesmo os criadores podem entender ou controlar, é um grande risco à humanidade.

Outro ponto levantado é o fato de que pouquíssimos países estão preparados para atuar na regulamentação dessas tecnologias, o que confirma a necessidade de os laboratórios ajudarem os governos no desenvolvimento e implementação de protocolos de segurança e políticas públicas para proteger os cidadãos.